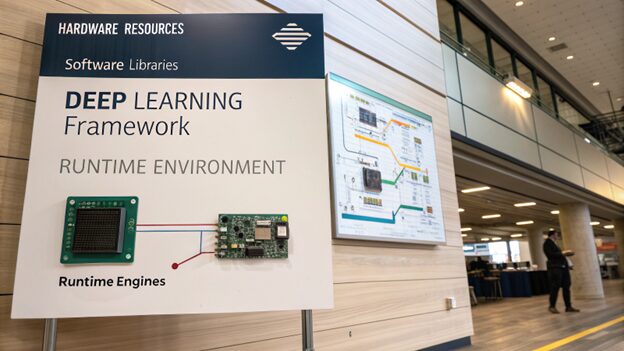

如何选择合适的深度学习框架运行环境

理解框架专属的运行环境依赖

不同深度学习框架的架构特性不同,对运行环境的要求也存在差异。以下为主流框架的核心需求解析:

TensorFlow:工业级框架主力军

TensorFlow以分布式训练的可扩展性著称,其高效运行需依托特定环境配置,关键考量包括:

- 分布式训练支持:需高带宽网络以降低节点间通信延迟

- GPU集群集成:需精准匹配CUDA工具包版本,同时优化TensorFlow Serving以适配生产部署需求

- 存储I/O性能:大规模数据集需依托低延迟的SSD存储系统实现快速访问

PyTorch:面向科研与快速原型开发的动态图框架

PyTorch因动态计算图的灵活性深受科研人员青睐,其对软件栈有特定要求:

- Python版本兼容性:通常需3.8及以上版本以支持最新库更新

- Jupyter Notebook远程访问配置:为协作实验提供必要支持

- CUDA/cuDNN版本同步:版本不匹配可能导致性能下降或运行错误

硬件配置:性能的核心支柱

硬件选择是运行环境优化的核心环节。以下为关键硬件组件的选型解析:

CPU与GPU:按需匹配计算任务与处理单元

CPU擅长串行处理与数据预处理,而GPU在深度学习模型训练关键的并行张量运算中表现突出。

- CPU选型考量:Intel Xeon系列等多核架构适用于数据接入流水线,时钟频率与缓存大小会影响预处理吞吐量

- GPU选型考量:NVIDIA产品线提供多样化选择——RTX系列性价比高,适合常规训练;A系列性能强劲,适用于大规模分布式场景下的高性能计算

内存与存储:平衡容量与速度

内存不足会导致频繁磁盘交换,而存储速度过慢则会成为数据加载的瓶颈。以下为最佳实践建议:

- 多数模型需至少32GB内存,大型语言模型或复杂视觉任务需扩展至128GB及以上

- 采用NVMe SSD存储数据集以实现亚毫秒级访问速度,HDD仅适用于冷数据存储

- 使用NVIDIA nvprof等内存分析工具识别内存分配效率问题

操作系统与软件栈优化

操作系统的选择会影响框架兼容性与开发流程:

Linux与Windows:生态系统的选择

Ubuntu 20.04 LTS等Linux发行版仍是深度学习领域的首选,原因包括:

- 对GPU驱动与开源工具链的原生支持

- 通过systemd、nmon等命令行工具实现更优的资源管理

- 与Docker、Kubernetes等容器化技术的无缝集成

Windows环境虽不常见,但适用于依赖PyCharm可视化分析器等图形化调试工具的团队,需通过WSL2搭建混合工作流。

依赖项版本控制

管理软件依赖项是避免兼容性问题的关键:

- 采用语义化版本(MAJOR.MINOR.PATCH)评估破坏性变更风险

- 使用Anaconda或Pipenv隔离环境,防止包冲突

- 通过锁定文件(如environment.yml或requirements.txt)自动化依赖项解析

区域服务器部署的战略优势

服务器的地理部署位置会影响延迟、合规性与成本——这些因素在运行环境设计中常被忽视。

区域服务器租用的关键考量

- 网络延迟:靠近数据源(如依托香港服务器租用设施实现对国际数据集的低延迟访问)

- 合规性:通过本地化存储满足GDPR或香港《个人资料(私隐)条例》等数据隐私法规要求

- 成本优化:平衡能源效率与服务器托管费用,香港等区域的高带宽基础设施具有性价比优势

本地与云节点混合架构

结合本地硬件与云资源可实现灵活的工作流:

- 使用本地服务器执行计算密集型训练任务

- 将推理任务卸载至云实例以实现弹性扩展

- 通过Kubernetes编排混合架构中的资源分配

容器化与编排最佳实践

Docker与Kubernetes彻底改变了运行环境的可复现性与可扩展性:

- Docker镜像优化:减少层数量、采用多阶段构建以缩小镜像体积

- Kubernetes调度:应用节点亲和性规则,确保GPU加速型Pod部署至兼容硬件

- 网络配置:利用区域DNS服务实现容器间低延迟通信

五步框架-环境匹配方法

按系统流程将项目需求与基础设施能力对齐:

- 明确工作负载需求:对任务分类(如图像分类、序列生成),确定计算与内存需求

- 选择框架适配的硬件:TensorFlow分布式训练搭配多GPU节点,PyTorch单节点训练搭配中端GPU

- 优化操作系统与软件栈:Linux环境采用预配置CUDA工具链的Ubuntu镜像,Windows Server环境优化DirectX

- 设计容器化策略:将环境打包为Docker容器以实现可移植性,结合Kubernetes进行集群管理

- 利用区域基础设施优势:选择能降低数据传输延迟、满足合规要求的服务器部署位置

成本管理与性能验证

平衡预算与性能需制定战略规划:

成本优化技巧

- 弹性扩展:根据训练周期在按需实例与预留实例间切换

- 资源池化:通过容器隔离技术实现多项目共享GPU资源

- 存储分层:将不常访问的数据集迁移至低成本HDD存储

性能基准测试

通过以下工具验证运行环境配置:

- 使用TensorFlow Benchmark测试不同批次大小下的训练吞吐量

- 通过PyTorch Profiler识别动态图中的计算瓶颈

- 采用iperf3等网络诊断工具测试分布式环境中的节点间通信速度

运行环境优化案例分析

以下实际案例展示了高效的运行环境选择方案:

计算机视觉创业公司

某公司采用PyTorch进行图像分割,部署的集群配置如下:

- 2块RTX 3090 GPU,用于并行批次处理

- 128GB内存,支持内存中处理大型图像数据集

- 香港服务器托管设施,实现对国际图像库的低延迟访问

结果:数据预处理和模型收敛速度比通用云配置快40%。

金融领域NLP项目

某项目采用TensorFlow构建金融文档情感分析模型,配置如下:

- Intel Xeon Platinum CPU,用于高效文本分词

- Tesla T4 GPU,用于合规敏感环境中的推理优化

- 加密服务器托管存储,符合PCI-DSS标准

成果:实现满足严格金融监管要求的安全、低延迟推理服务。

结语:构建面向未来的基础设施

选择合适的深度学习框架运行环境需采用整体视角,整合框架特性、硬件能力与区域基础设施优势。通过系统评估工作负载需求、优化软件依赖项、利用战略位置的服务器租用资源,团队不仅能加速开发进程,还能适应边缘计算、量子机器学习等新兴趋势。目标是构建具备韧性的基础设施,将计算资源转化为竞争优势,确保深度学习项目始终处于技术创新前沿。需注意的是,运行环境设计并非一次性任务,而是持续优化的过程——细致规划终将带来持久的性能提升。